(und von DeepFakes & FakeNews)

Damit Sie die Arbeit verstehen, müssen Sie zunächst verstehen, woraus diese „Talking Heads“ bestehen, von denen ich Ihnen bereits 2019 erzählt habe, wobei mit einem einzelnen Rahmen oder einer Reihe davon ein Kommunikationsmodell angewendet werden kann. Transferlernen um eine Kopfbewegung zu bewirken. Ein Prozess, der auch als bekannt ist Gesicht Renaissancee, und von dem Sie das Video des Jahres erklärt haben 2019.

Jetzt mit dem Modell VASA-1geht der Prozess weiter und es werden ein Foto und eine Audiodatei angegeben, die Sie mit einem „einbinden“ möchten.Sprechender Kopf“, Sie erhalten eine Animation mit “Visuelle affektive Fähigkeiten” oder was auch immer, mit sehr humanisierten Gesten.

Das Endergebnis ist eine animierte Datei der als Eingabe verwendeten Person, die sehr menschlich zum Eingabeaudio spricht und gestikuliert, mit Lippensynchronisation. Zur Durchführung der Tests verwendeten die Forscher Synthetische Menschen generiert mit StyleGAN-2 – Ich habe dir auch davon erzählt 2019 im Artikel: „Style GAN: Eine KI zum Erstellen von Profilen von Menschen, die NICHT existieren“ und wo die Website „Diese Person existiert nicht“ besprochen wird – und die es ermöglicht, aus zwei Fotografien von Menschen (real) Menschen zu erstellen, die nicht existieren oder synthetisch).

In ihrer Arbeit haben die Forscher das Modell erweitert und es geschafft, diesen Prozess in hoher Qualität in Echtzeit durchzuführen, die Frames mit der Gestikulation zu generieren und die Lippen bei der Verarbeitung der Audiodatei zu synchronisieren, was Auswirkungen auf die Audiodatei haben könnte Welt der Cybersicherheit, wie z DeepFakes fast perfekt, oder als Begleitung FakeNews glaubwürdiger. Das bedeutet, dass es noch keine Pläne für die Veröffentlichung gibt API des implementierten Modells noch ein Produkt. Hier können Sie sehen, wie es funktioniert Echtzeit.

Dies ist eine Arbeit der Firma BeHumans, und natürlich sind diese Fortschritte durch Forschung wie z VASA-1 Sie orientieren sich am positiven Teil des GenAIdas heißt, die Interaktion der Menschen mit Technologie weiter zu humanisieren, ihre Akzeptanz zu erhöhen und die digitale Kluft bei älteren Menschen zu verringern, denen es leichter fallen wird, neue digitale Dienste zu nutzen.

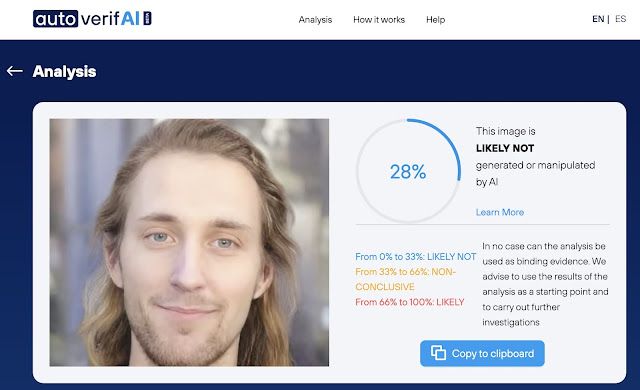

Abbildung 9: Ein von TID erstelltes AutoVerifAI-Prototypvideo

Andererseits zwingen uns diese neuen Algorithmen für das Spiel der Generierungsinhaltserkennung durch GenAI, das wir bei AutoVerifAI betreiben, dazu, die Erkennungsalgorithmen zu überprüfen, um neue Wege zu ihrer Erkennung zu finden und herauszufinden, welche am besten funktionieren. Sie erkennen Anzeichen dafür.

Abbildung 10: DeepFakes-Videoerkennungsalgorithmen in AutoVerifAI

In den mit VASA-1 erstellten Videos sind angesichts dessen nur wenige Anzeichen zu erkennen

extremer Realismus in „Visual Affection Skills“,

wodurch sie den menschlichen Mikrogesten viele Details verleihen.

Zum Beispiel mit den Algorithmen Kopfhaltung, Blinken Und LRCN/VIT die wir jetzt in der kostenlosen Version haben, in diesem Video des Artikels gibt es nur sehr wenige Anzeichen dafür, dass es sich um eine handelt DeepFakewährend, wenn wir nur ein Bild mit dem Gesicht der Person aufnehmen, die Anhaltspunkte zunehmen, um auf a zu basieren StyleGan.

Abbildung 11: Mit GenAI generierte Erkennung für Bilder,

AutoVerifAI erhöht die Hinweise, dass es durch KI generiert wird, um bis zu 28 %.

Aber wie Sie sehen, sind die Werke der Perfektion in GenAI Um digitale Menschen perfekter zu machen, erfordern sie immer mehr Arbeit, um eine deterministische forensische Analyse durchzuführen, und es müssen immer mehr Tests durchgeführt werden, um sich eine Meinung bilden zu können.

Böse Grüße!